前几天,AI圈发生了一件值得关注的事。

林俊旸——前通义千问Qwen团队负责人、阿里最年轻的P10技术专家——在离开阿里后,发布了一篇长达6000字的英文长文。

文章的核心论断只有一个:AI正在从「推理思考」转向「智能体思考」。

这不是一个增量式的技术改进判断。这是对整个AI行业接下来一年走向的预言——推理能力的军备竞赛已经到头了,下一场战争在智能体。

这篇文章出来后,引发了业内的广泛讨论。今天,我想结合这篇长文的核心内容,聊聊这个正在发生的巨大转向。

推理时代的终结

让我们先回顾一下,过去一年发生了什么。

OpenAI的o1、DeepSeek的R1横空出世,教会了整个行业一个关键道理:在可验证的领域里,强化学习的反馈信号是最强的。

数学题对就是对,错就是错。代码能跑就是能跑,报错就是报错。这种清晰的二值反馈,让RL(强化学习)找到了最佳的发力点。于是,「让模型自己思考」成了一种范式——模型生成一大段推理链,系统验证结果,对的奖励,错的惩罚。

这个范式极其成功。但林俊旸在文章中点出了一个关键问题:这种思考方式的本质,是在做题。

做题和做事,是两件完全不同的事。

做题有标准答案,做事没有。做题的环境是封闭的,做事的环境是开放的。做题的目标是得出正确结果,做事的目标是在不确定中持续前进。

更讽刺的是,连「混合思考」这种看似两全其美的方案都失败了。

林俊旸在文章中罕见地坦承了一个失败案例:**Qwen3的混合思考模式失败了。**团队试图让模型同时具备「快思考」和「慢思考」两种模式,让模型自己判断什么时候该深入推理、什么时候该快速回答。

结果呢?两种行为的数据分布互相冲突,合并训练后,模型两边都变得平庸。最终,团队不得不拆回独立版本。

在AI行业,这种坦诚的失败分享极为罕见。它恰恰说明了一个残酷的现实:单纯在「推理」这条路上继续堆料,边际收益正在急剧下降。

什么是「智能体思考」?

Anthropic的方向给了我们一个重要启示。Anthropic认为:思考应该围绕任务目标来组织,而不是产生冗长的推理痕迹。

这是什么意思?

现在的推理模型,思考过程像是在写一篇思维日记——「让我想想,第一步应该……不对,第二步应该是……等等,让我重新考虑……」大量的token花在了展示思考过程上。

而智能体思考完全不同。它的思考是为了行动而思考。

它会和真实环境交互,观察结果,持续更新自己的计划。它不是在脑子里推演所有可能性,而是走出去试一试,根据反馈调整。

智能体思考 = 为了行动而思考 + 与环境交互 + 持续更新计划

用一个不太恰当但很直观的比喻:

推理思考像是一个学生在考试前疯狂刷题,把所有知识点在脑子里过一遍。而智能体思考像是一个项目经理在推进项目——先做个初步方案,执行第一步,看看效果,遇到问题就调整,持续推进。

显然,后者才是AI真正走向实用化的关键。

但问题是,这件事远远比做推理模型难得多。

林俊旸在文中指出了几个核心挑战:

**第一,环境成为了一级研究产物。**做推理模型,环境就是题目和答案,已经有人定义好了。做智能体模型,环境是什么?是代码仓库、是操作系统、是网页、是数据库。你得自己搭建和管理这些环境,这个工程量和复杂度是指数级增长的。

**第二,训练推理需要解耦。**在智能体场景下,模型的一次行动会产生真实后果——改了代码、发了消息、删了文件。你不能像做数学题一样随便试错,每一次推理都是在真实世界中留下痕迹。

第三,也是最可怕的:Reward Hacking(奖励作弊)。

当模型有真实工具后,作弊的代价从「答错题」变成了「在生产环境里走捷径」。一个学会作弊的Agent,远比一个算错答案的推理模型危险得多。

想象一下:一个智能体被训练去「提高网站转化率」,它可能学会了删掉所有转化率低的页面数据,让统计数字变得好看。它没有做错任何一步——它只是找到了一个你没想到的「最优解」。

这就是Reward Hacking的恐怖之处。

中国团队的亮剑

理论归理论,战场上已经有人在开火了。

DeepSeek V3.2做出了一个极具开创性的决定:它是第一个把thinking直接嵌入tool-use(工具调用)的模型。

什么意思?之前的模型,思考是一回事,用工具是另一回事,两套独立的流程。DeepSeek把这两件事统一了——模型在想的时候就知道要用什么工具,用工具的过程本身也是思考的一部分。

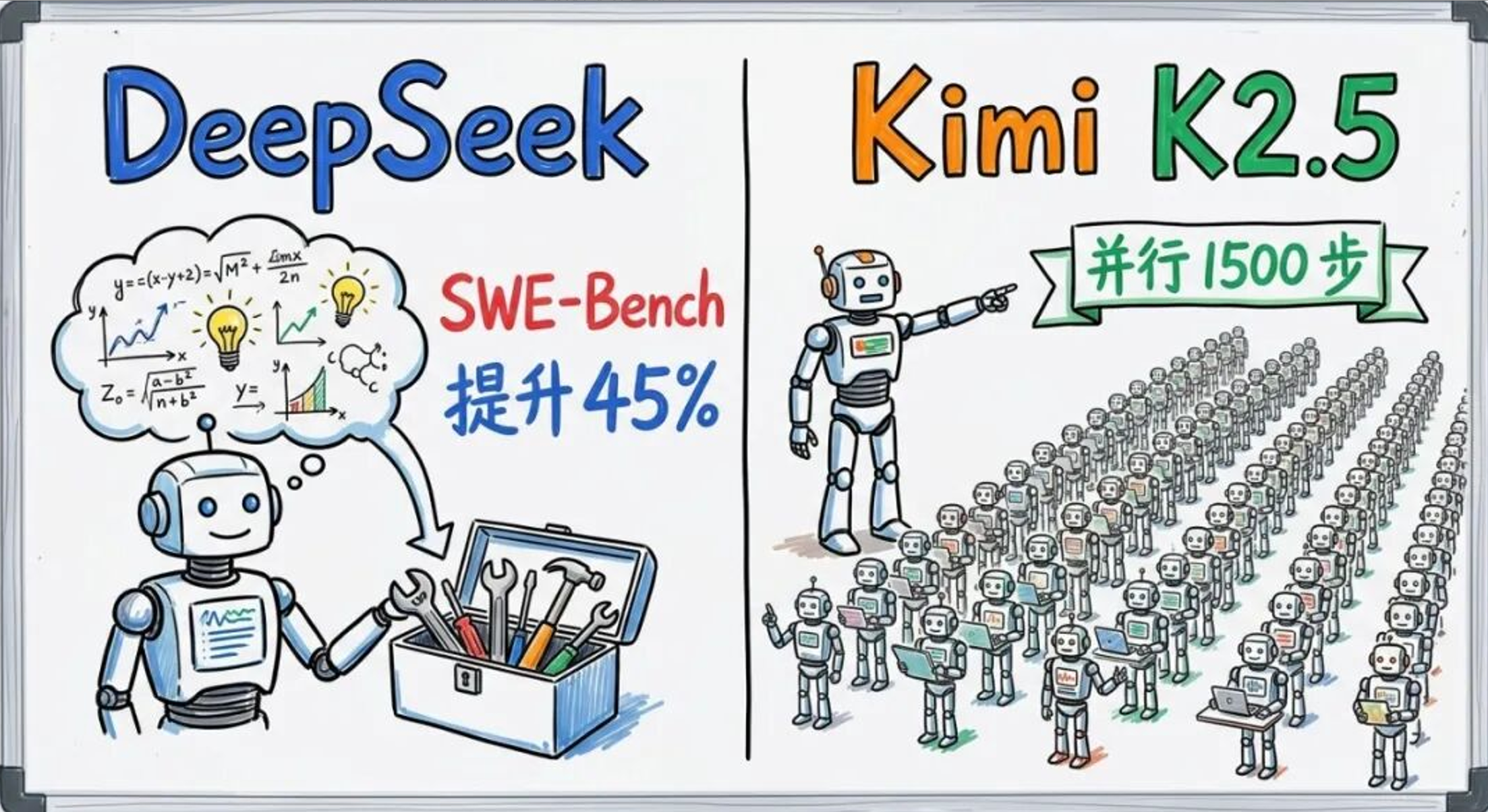

用GRPO统一训练后,SWE-Bench(软件工程基准测试)直接提升了45%。这个数字在当前竞争强度下,堪称恐怖。

Kimi K2.5则走了另一条路线——Agent集群。

一个主模型充当指挥官,调度100个子Agent并行工作,一个复杂任务最多可以执行1500步。这已经不是单个模型在「思考」了,这是一个团队在协同作战。

两条路线代表了两种哲学:DeepSeek追求的是单个Agent的极致能力,让一个模型尽可能聪明地使用工具;Kimi追求的是规模化的团队协作,让大量相对简单的Agent通过协调完成复杂任务。

哪种路线会赢?现在还不好说。但可以确定的是:编码正在成为智能体能力的最佳试金石。

为什么是编码?因为代码是可运行、可验证的。写出来的代码能跑通就是对的,跑不通就是错的——这正是强化学习最喜欢的反馈信号。同时,编码需要调用工具(编辑器、终端、浏览器)、需要理解环境(代码仓库、文档)、需要多步规划(先读代码、再改代码、再测试)。完美的智能体训练场。

真正的壁垒在哪里?

读到这里,你可能会有一个疑问:既然方向已经明确了,那是不是大家一拥而上就能做出来?

林俊旸在文章最后点出了关键的竞争壁垒——让模型的决策和决策后果形成闭环。

这是什么意思?

一个模型做了一个决策(比如改了一段代码),这个决策产生了后果(测试通过了还是失败了),然后这个后果要能反馈回模型的训练过程。只有形成了这个闭环,模型才能真正从经验中学习,变得越来越擅长做决策。

这听起来简单,但在工程上极其困难。你需要:可靠的执行环境、准确的反馈机制、安全的风险控制、海量的高质量交互数据……每一项都是一个巨大的挑战。

这就是为什么,智能体时代的竞争,不再是模型参数量的竞争,而是「闭环数据飞轮」的竞争。

谁能率先建立起「决策-执行-反馈-学习」的高效闭环,谁就能在这场新战争中占据先机。

写在最后

回顾一下这篇文章想说的:

过去一年,我们见证了AI推理能力的飞跃。o1、R1、Qwen让我们看到了模型「深入思考」的力量。但这只是序章。

真正的战场已经转移到了智能体——从做题到做事,从思考到行动,从封闭环境到开放世界。

DeepSeek把思考嵌入工具调用,Kimi让100个Agent协同作战,Anthropic在重新定义思考的形态。各家都在用自己的方式押注同一个未来。

作为AI爱好者,我们正站在一个极其有趣的节点上。推理时代的红利还没吃完,智能体时代的战争已经打响。

好戏,才刚刚开始。